Moin zusammen,

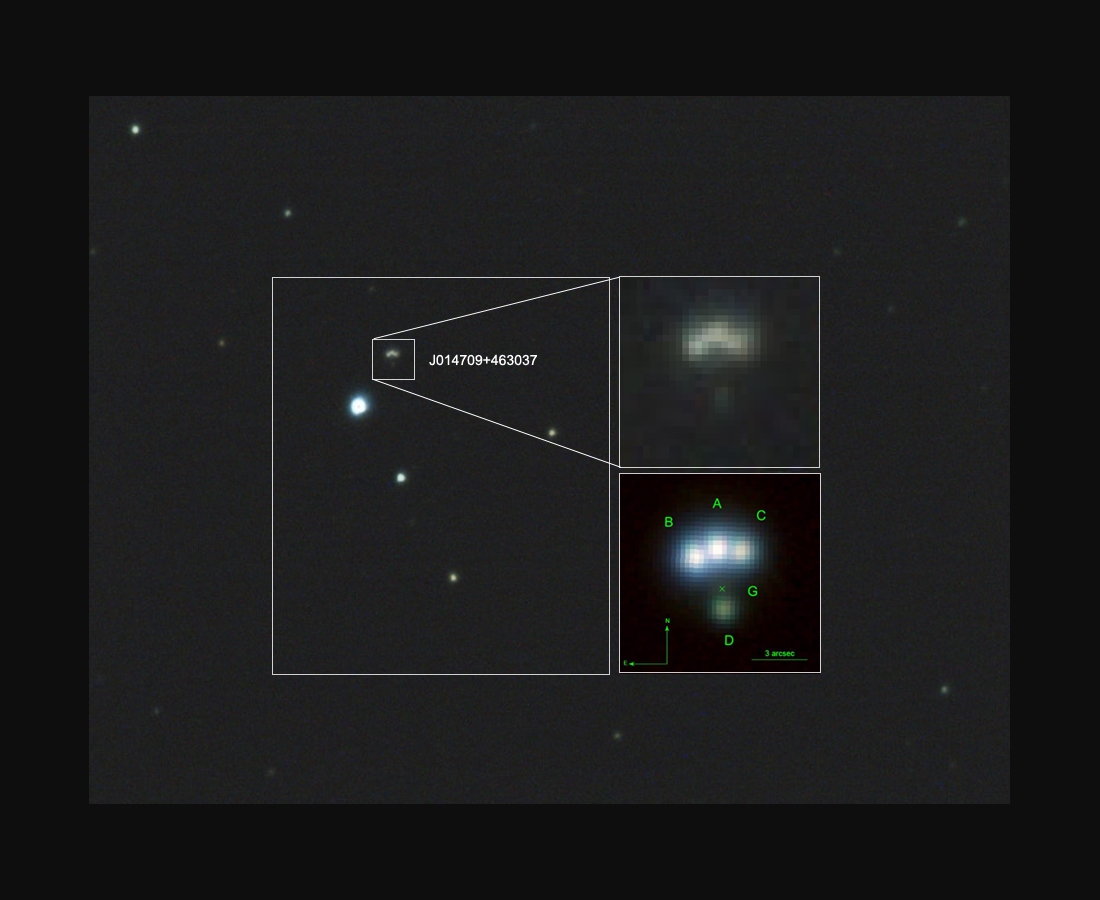

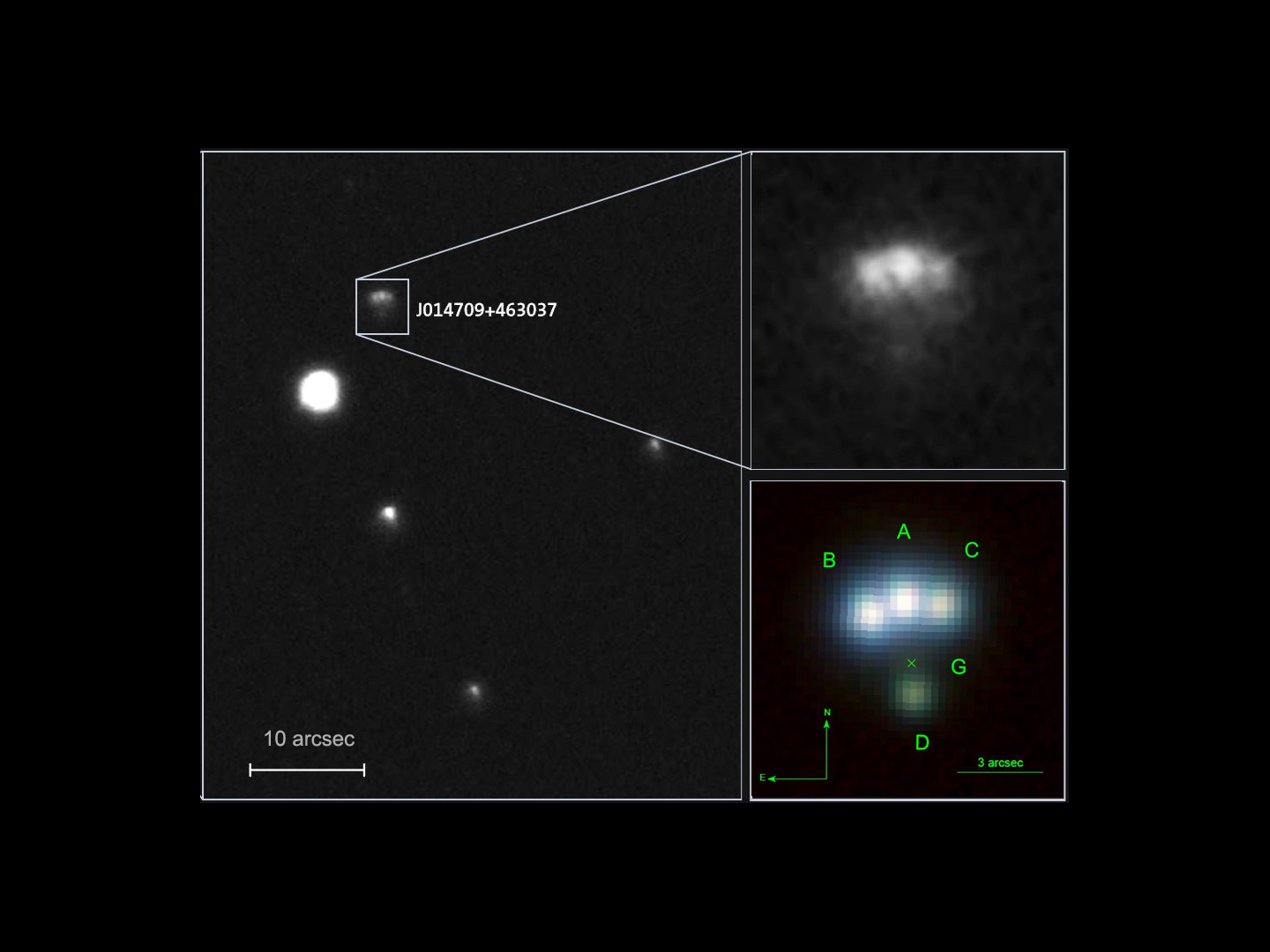

Andromeda's Parachute wurde 2017 von PAN-STARRS (PS1) Hawaii bei einer Durchmusterung entdeckt. Es handelt sich um einen Quasar, der durch eine Gravitationslinse uns vierfach erscheint, Astrophysik pur. Einstein hatte es in den 1930'ger Jahren vorhergesagt. Heute sind nur eine Handvoll von Vierfachsystemen bekannt.

Das Vierfachsystem hat eine Größe von 3,8 Bogensekunden. Nun hab ich den kleinen Burschen im Celestron C14 (+ Reducer) mit einer ASI294MC Farbkamera aufgenommen, das Sampling lag so bei 0.38". Die Brennweite lag nun bei gut 2600 mm und die Belichtungszeit pro Einzelframe genau 1 Sekunde. Aufgenommen mit SharpCap und gestacked mit Autostakkert. Die Verwendungsrate in Autostakkert lag bei mäßigen 50 %, lucky imaging, d.h. jede zweite Aufnahme ist gestackt worden.

die Story zum Bild hab ich in einem kleinen 4 Min. Video festgehalten...

P.S. das C14 wiegt ca. 22 Kg, in Zeiten HomeOffice muss man sich ja fit halten ![]()

![]()

cs