Hallo Karbofreunde,

hatte ja versprochen eine Software zu basteln, mit der man Bildaddition in Echtzeit machen kann.

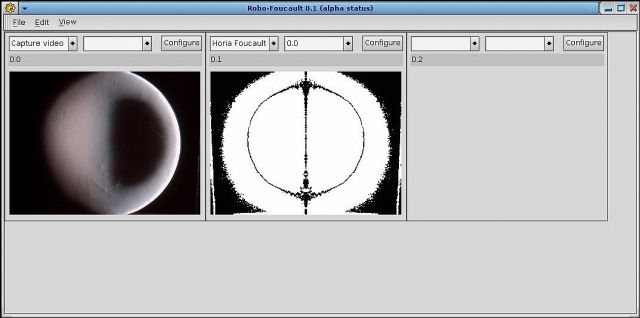

Hier sodann der erste Versuch an einem (6" f/5).

Das Bild zeigt von links nach rechts das Original von der WebCam und als zweites die Summation aus Spiegelbild und original.

Was meint ihr ? Sieht doch schon prima aus oder?

Ich muss natürlich noch die Bildparameter anpassbar machen, also Helligkeit, Kontrast etc.

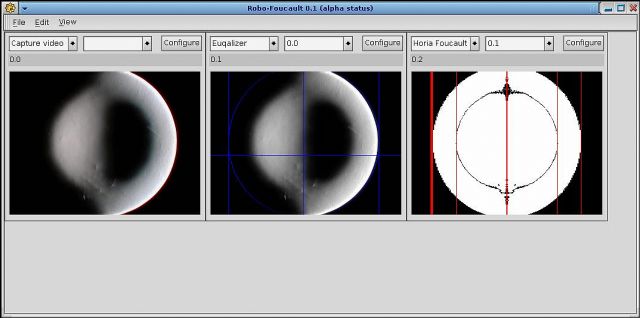

Jetzt kann man eine Zone direkt anfahren und messen ![]() Also wieder wie gehabt und nicht rückwärts [:D]

Also wieder wie gehabt und nicht rückwärts [:D]

Überigens, für die Glasstaubsüchtigen, die bereits nach der Bildsummation per Einzelbild gearbeitet haben. Wenn die Klinge auch nur um Bruchteile eingeschwenkt wird, ändert sich sofort heftig der angezeigete Zonenring!

Ich vermute allerdings, das dies auch durch die 'Rohverarbeitung' in meinem Programm hervorgerufen wird, da ich nicht auf die Maximal und Minimalwerte skaliert habe. Das kommt im nächsten Schritt.

Für etwaige Anregungen und Kritik wäre ich sehr dankbar.