Da hier bei uns im Süden Österreichs seit vielen Wochen sehr schlechte Wetterbedingungen herrschen, habe ich mich an ein Projekt gemacht, dass mir schon sehr lange am Herzen liegt.

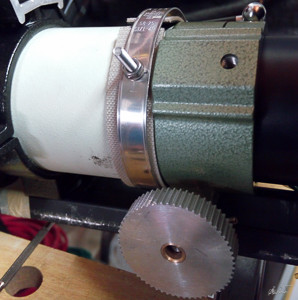

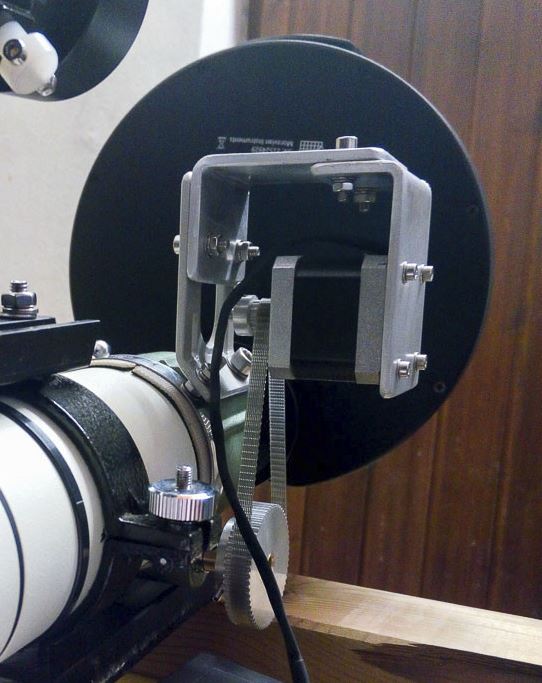

Ich betreibe neben dem Newton auf einer EQ-8 parallel auch einen kleinen Pentax SDHF75 Refraktor auf einer EQ-3.

Seit ich diesen mit einer CCD Kamera, anstatt der EOS ausgestattet habe, ist das Scharfstellen zu einem echten Abenteuer geworden.

Die Kamera ist sehr schwer und durch das externe Filterrad ist der Zugang zu den Stellschrauben kompliziert und der Okularauszug hat keine Untersetzung.

Für den Pentax gibt es am Markt keine fertige Motorfokus Lösung, so suchte ich nach einer Selbstbau-Lösung.

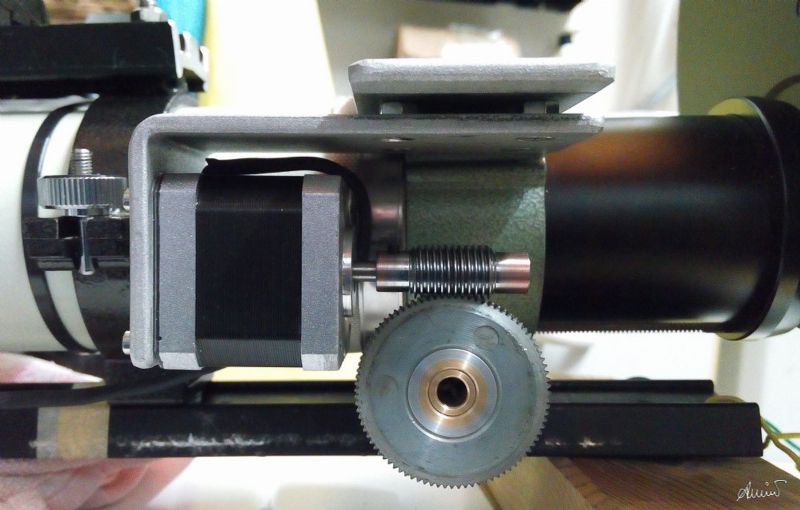

Gefunden habe ich jene von Ivaldo Cervini, einem italienischen Amateurastronomen, der wie ich finde, eine sehr gute und zugleich einfach nachzubauende Lösung präsentiert.

Ich werde meine Baufortschritte hier Schritt für Schritt vorstellen, im Moment stecke ich noch bei der Mechanik etwas fest.

Wer möchte, kann parallel dazu auch auf meiner alten Homepage (http://www.a2p.at/Astronomie/StepperFoc_Pentax.html) den etwas detaillierteren Bericht mit größeren Bildern lesen…

<font size="3"><b>Auswahl der Software und Hardware-Plattform</b></font id="size3">

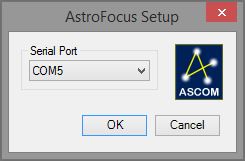

Hier entschied ich mich recht schnell für die Arduino Platinen, da diese sehr günstig und auch für Einsteiger einfach zu programmieren sind.

Bei der Software gibt es eine Unzahl an Projekten, die sehr unterschiedlich sind.

In der näheren Auswahl standen unter anderem folgende:

<ul><li>AstroFocus</li>

<li>ArduinoFocus</li>

<li>myFocuser</li>

<li>SGL Ascom Motor Focus Control</li>

<li>Arduino based motor focus controller</li>

</ul>

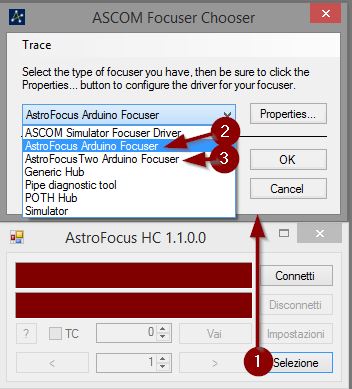

Ich entschied mich für das AstroFocus Projekt von Ivaldo aus mehreren Gründen:

+ optimal zum Einstieg, viele andere Projekte sind zu überladen und zu komplex

+ einfach und mit Standardelementen (Adafruit Motorshield, Adafruit Temperatursensor, …)

+ Temperaturkompensation

+ bietet 2 Ascom Treiber für den dualen Betrieb an (Danke noch einmal Ivaldo)

- Webseite nur in Italienisch verfügbar (ist aber dank google translate kein Problem)

Ivaldo beschreibt auf seiner Webseite sehr genau den Aufbau seines Fokussers, die Bilder das Video und die Tabellen sind dabei sehr hilfreich.

Es existieren auf seiner Webseite 3 Variationen seines AstroFocusers, die unterschiedliche Motorplatinen unterstützen (Arduino Motorshield und Adafruit Motorshield v2).

Eine Variante (AstroFocus3) besitzt statt der Steuertasten einen Endschalter zum Setzten des Nullpunktes, das ist für nichtstationäre Astronomen sehr hilfreich.

<font size="3"><b>Arduino Hardware</b></font id="size3">

Der Zusammenbau der Komponenten gestaltete sich recht einfach.

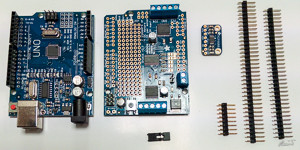

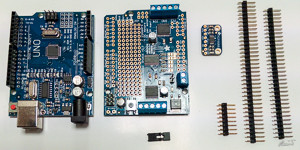

Folgende Geräte habe ich verwendet:

<ul><li>Arduino Uno Clone (mein originaler Arduino war leider defekt) ~ € 13.—</li>

<li>Adafruit Motorshield ~ € 30.—</li>

<li>Temperatursensor I²C MCP9808 ~ € 8.—</li>

<li>Gehäuse für Arduino ~ € 13.—</li>

<li>Netzgerät für den Arduino 12VDC/ 1,5A ~ € 15.—</li>

<li>Taster & Gehäuse für Handbedienung ~ € 15.—</li>

<li>Schrittmotor PSM42BYGHW603 1,8° (12V) ~€ 16.—</li>

</ul><i>Die Links zu Bezugsquellen befinden sich auf meiner Homepage, da die Forensoftware komplexe Links leider nicht darstellen kann.</i>

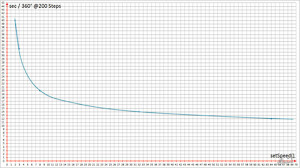

Wichtig ist beim Schrittmotor neben dem Drehmoment (0,38 Nm) auch die Spannung, da ich die Spulen immer bestromt lasse.

Damit ist ein Haltemoment gegeben, das verhindert, dass sich der Fokusser während des Fotografierens bewegt. Versuche mit einem kleineren Motor (6V) führten zu einer starken Überhitzung.

Die Materialkosten betrugen rund € 110 .— zuzüglich der Kosten für die mechanische Ankopplung, dazu aber später mehr.

Arduino Uno, Motorshield und Temperatursensor, wobei hier noch ein wenig Lötarbeit zu machen ist.

(Ansonsten werden die Platinen bis auf die Pfostenstecker fertig aufgebaut geliefert.)

Temperaturfühler, Schrittmotor, Arduino im Gehäuse und Handsteuerbox fertig aufgebaut.

Fortsetzung (Software und Ascom Treiber) folgt...

-->

-->

-->

-->

-->

-->

-->

-->

-->

-->