Hallo ins Forum,

Ich würde gerne auf der Lernkurve bei der Astrofotografie weiterkommen. Nach einer Reihe von Miss- und Teilerfolgen läuft bei mir das Guiding, als auch die Bilderfassung. Es gab auf dem Weg so Maches Hindernis. Ob kaputte Steuerungselektronik bei der Montierung, Motoretausch, ungenaue Einnordungen, fehlender Guider, falscher Reducerabstand, falsch belichtete Flats, Bildfelddrehung und was es sonst noch so alles gibt. Ich denke, Ihr wisst,wovon ich rede...

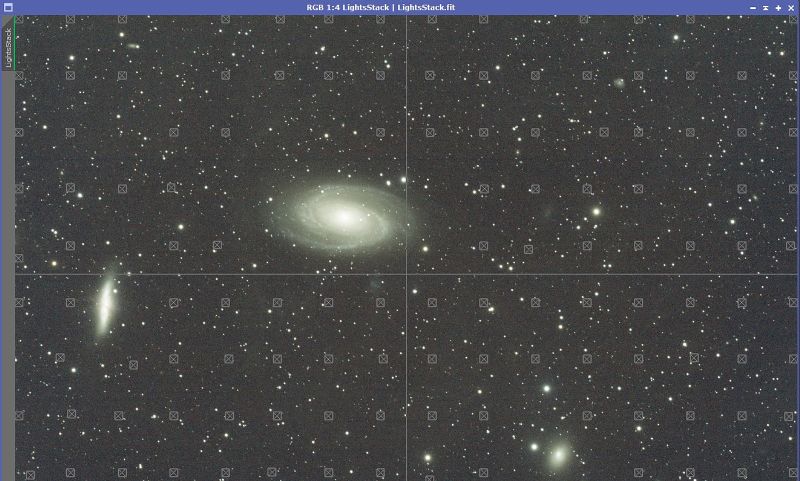

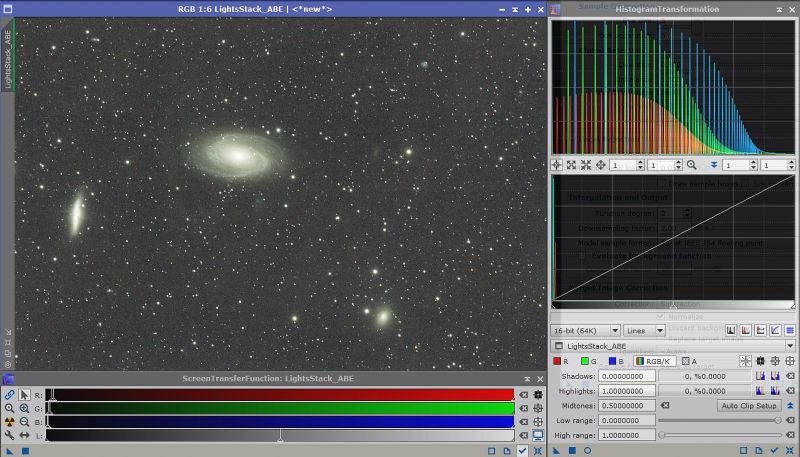

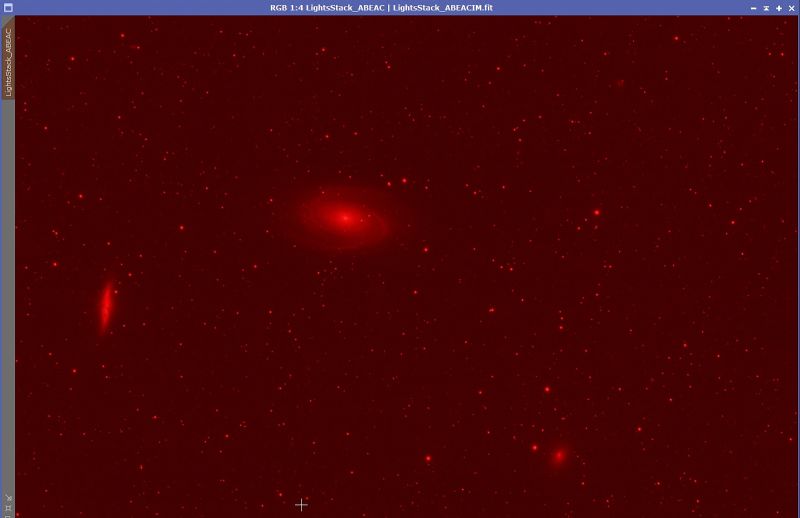

Nun ist aber m.E. die erste brauchbare Aufnahmeserie im Kasten. Ziel war M81 / M82. Da ich es immer ein wenig schade finde, wenn sehr wenige Daten zu der Bildentstehung geschrieben werden, mach ich dies hier mal voll umfänglich:

Set-Up:

Montierung: EM-200 / FS-2 / SECM3 Motore mit 10:1 Vorgetriebe

Guider: Refraktor 76/570 mm

Optik: Refraktor mit Reducer auf 120/672 mm

Aufnahmen:

Kamera: Canon 550D unmodifiziert

Belichtungen: Lights: 11 x 12min bei ISO 400 / RAW

Darks: 6 x 12min bei ISO 400 / RAW

Flats: 20 x 1/20sec bei ISO 400 / RAW

Bias: 100 x 1/4000sec bei ISO 400 / RAW

Wetter: Gute Transparenz, -2°C ~ konstant über die Aufnahmeserie, 21.0mag/arcsec², taufrei

Guiding: MGEN an FS-2 mit folgenden Parametern:

Guider

Obj. focus: 570mm

AG speed RA: 0.25x

AG speed DEC: 0.25x

CCD-Binning: 1x1

1/5

Verstärkung: 8

Belichtung: 700

Limit: 10

2/5

invert RA: -

invert DEC: -

3/5 - RA

Num: 1

tol.: 0.25

aggr.: 30%

mode: 1

4/5 - DEC

Num: 1

tol.: 0.25

aggr.: 30%

mode: 1

Kalibration

RA: 0.70px

DEC: 1.63 /s

Ortho: 100%

MGEN Canon Steuerung:

Displacer: Enable, uniform square mit 16px

Soweit so gut. Ich bin mit der Montierung, der FS-2 und dem MGEN incl. der Kameransteuerung absolut zufrieden.

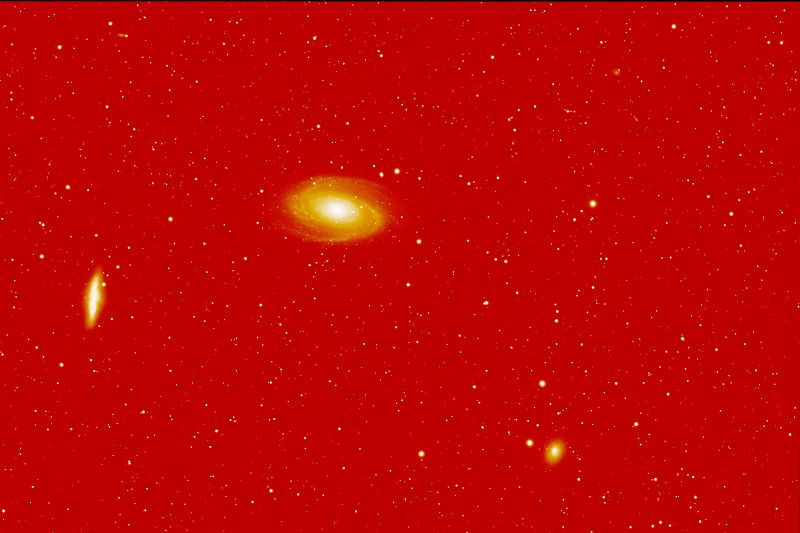

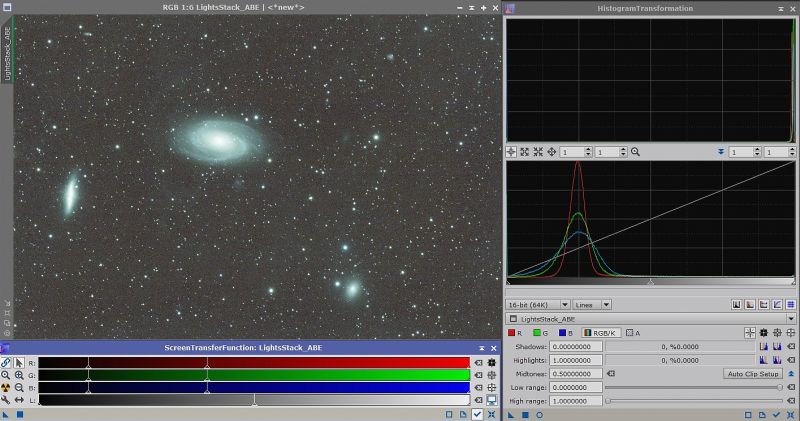

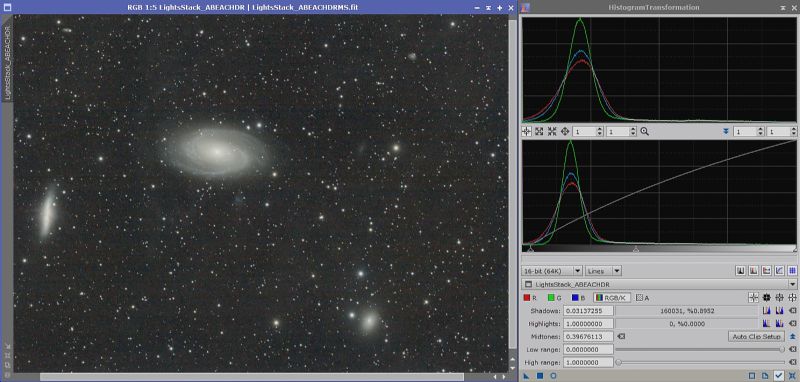

Die erhaltenen Einzelbilder sehen für mich gut aus (Galaxienkern / helle Sterne minimal ausgebrannt, Farbe und Staubband gut mit drauf):

Histogramm Einzelaufnahme:

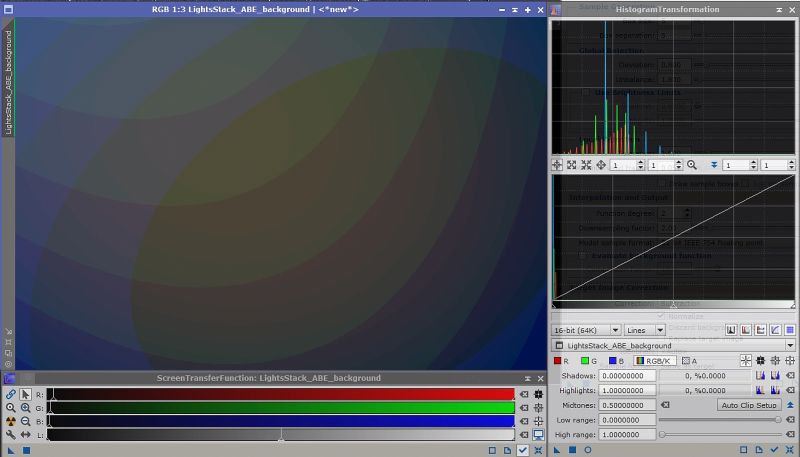

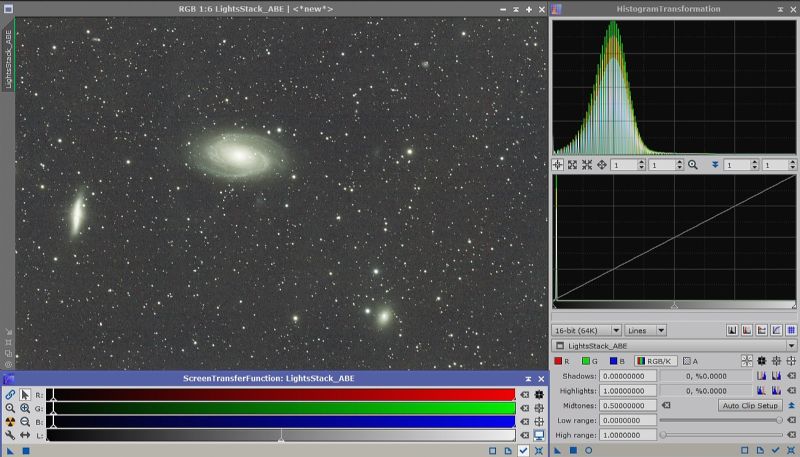

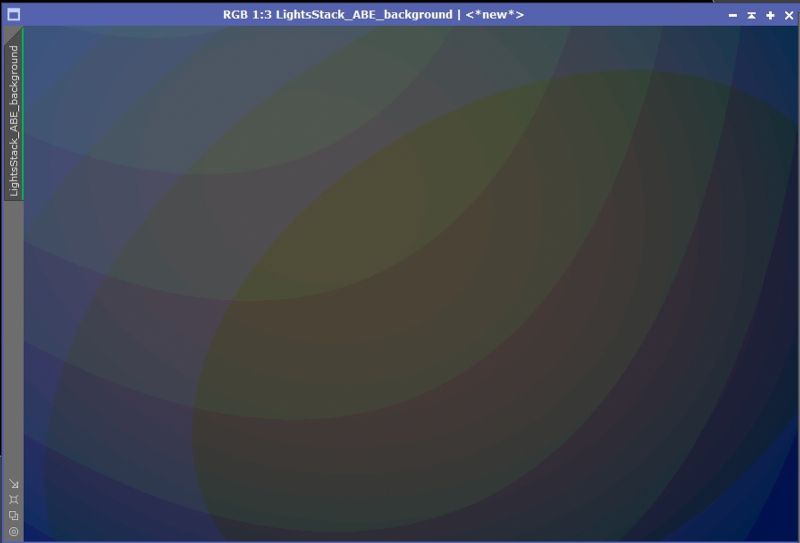

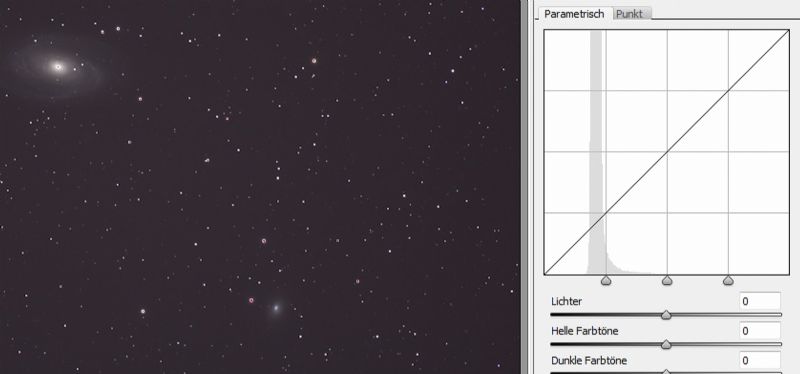

Nun kommt die nächste Hürde, die Bildbearbeitung in Pixinsight. Da ich erst kürzlich von DSS zu Pixinsight umgeschwenkt bin, fehlt mir das Wissen.

Ich würde gerne Stück für Stück die Bildbearbeitung beschreiben und was mir dabei an Fragen in den Sinn kommt. Da kann ich - und vielleicht auch andere Mitleser - was dabei lernen. Es wäre schön hier Tips von erfahrenen Hasen zu bekommen. Ich probiere es in kleinen Scheibchen (also über einige Tage immer etwas weiter im Prozeß). Vielleicht gibt es den Einen oder Anderen, der Lust hat die Reise mit zu Begleiten.

Ich würde mich freuen.

Gruß

Dirk